Qwen 3.5: Das neue LLM für lokale KI-Nutzung

Qwen 3.5 von Alibaba Cloud bietet Entwicklern ein leistungsstarkes, lokal nutzbares KI-Modell mit multimodalen Fähigkeiten.

Qwen 3.5, das neueste Large Language Model (LLM) von Alibaba Cloud, wurde Anfang Februar 2026 veröffentlicht und stellt eine bedeutende Weiterentwicklung in der Qwen-Modellreihe dar. Dieses Modell ist unter der Apache-2.0-Lizenz verfügbar, was bedeutet, dass Entwickler und KI-Enthusiasten es frei nutzen, modifizieren und lokal betreiben können. Mit einer Mixture-of-Experts-Architektur (MoE) und etwa 397 Milliarden Parametern bietet Qwen 3.5 eine effiziente Lösung für komplexe KI-Anwendungen.

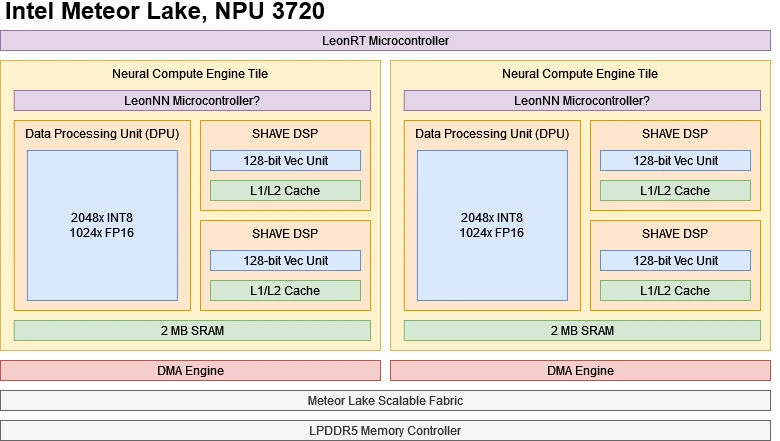

Die Architektur von Qwen 3.5 ermöglicht es, dass pro Token nur ein Bruchteil der Parameter aktiviert wird, konkret 17 Milliarden aktive Parameter. Dies führt zu einem vergleichsweise geringen Rechenaufwand, was für Entwickler von Vorteil ist, die auf leistungsstarker Hardware arbeiten. Zudem kann Qwen 3.5 multimodal arbeiten, was bedeutet, dass es Text, Bilder und Videos versteht, ohne dass zusätzliche Adapter erforderlich sind. Diese Fähigkeit macht es zu einem vielseitigen Werkzeug für verschiedene Anwendungen.

Verbesserte Funktionen und Leistungsfähigkeit

Die .5-Version von Qwen steht für eine bedeutende Weiterentwicklung im Vergleich zu früheren Modellen. Zu den Verbesserungen gehören optimierte multimodale und visuelle Fähigkeiten sowie eine größere Sprachabdeckung, die über 200 Sprachen und Dialekte umfasst. Darüber hinaus wurde die Nutzung der Rechenressourcen effizienter gestaltet, was die Leistung des Modells weiter steigert. Die verbesserten „Thinking“-Fähigkeiten ermöglichen ein tieferes logisches Schlussfolgern, was für viele Anwendungen von entscheidender Bedeutung ist.

Qwen 3.5 tritt in direkter Konkurrenz zu anderen modernen Modellen wie GPT-5.2, Anthropic’s Claude Opus 4.5 und Google Gemini 3 Pro an. In verschiedenen Benchmarks hat Qwen 3.5 in Bereichen wie Instruktionsfolgen, Dokumentenverständnis und Agentilaufgaben überdurchschnittliche Ergebnisse erzielt. Diese Leistungsfähigkeit macht es zu einer attraktiven Option für Entwickler, die nach leistungsstarken KI-Lösungen suchen.

Vorteile der lokalen Nutzung

Ein wesentlicher Vorteil von Qwen 3.5 ist die Möglichkeit, das Modell lokal zu betreiben. Im Gegensatz zu vielen proprietären Systemen, die auf Cloud-APIs angewiesen sind, können Nutzer die Gewichte des Modells über Plattformen wie Hugging Face herunterladen und auf eigener Hardware ausführen. Dies bietet eine Reihe von Vorteilen, darunter Datenschutz und Kontrolle über die eigenen Daten, da keine Informationen an externe Anbieter übertragen werden müssen.

Ein weiterer Vorteil ist die Vermeidung von API-Kosten, die bei cloudbasierten KI-Diensten anfallen können. Entwickler und Unternehmen können Qwen 3.5 ohne nutzungsabhängige Gebühren nutzen, was die Kosten für die Implementierung von KI-Lösungen erheblich senken kann. Zudem haben Nutzer die Flexibilität, das Modell jederzeit anzupassen, fein zu tunen oder in eigene Projekte zu integrieren, was besonders für Open-Source-Enthusiasten von Bedeutung ist.

Die Qwen 3.5-Familie ist modular aufgebaut und umfasst neben dem großen Modell auch kleinere Varianten, die sich besser für lokale Rechner eignen. Diese Modularität ermöglicht es Entwicklern, die für ihre spezifischen Anforderungen am besten geeignete Version auszuwählen. Laut Dokumentation gibt es neben dem großen 397B-Modell auch Varianten, die für weniger leistungsstarke Hardware optimiert sind.

Qwen 3.5 ist somit nicht nur ein leistungsstarkes KI-Modell, sondern auch eine flexible Lösung für Entwickler, die in der Lage sein möchten, KI-Anwendungen lokal und unabhängig von großen Cloud-Anbietern zu erstellen und zu betreiben.

comment Kommentare (0)

Noch keine Kommentare. Schreiben Sie den ersten!

Kommentar hinterlassen